Об использовании ИИ

Ранее мы с вами обсуждали тему использования нейросетей при выполнении домашних заданий школьниками. Помню, как многие родители тогда волновались, а учителя пытались понять, как с этим бороться. Это был такой первый звоночек, который показал, насколько быстро технологии проникают в нашу жизнь, даже в самые обычные, казалось бы, вещи.

Вместе с тем искусственный интеллект популярен не только у детей при решении задач и написании сочинений. Это уже давно не какая-то там абстрактная идея из фантастических фильмов, а вполне реальный инструмент, который активно используют во многих сферах. И это, надо признать, иногда очень удобно и полезно.

К ИИ стали прибегать даже в тех сферах, где его применение по сути своей недопустимо. И вот тут становится уже не так весело, а скорее тревожно. Когда технологии начинают вмешиваться в то, что требует человеческого суждения, эмпатии и глубокого понимания контекста, возникают серьезные проблемы.

Например, при вынесении судебных решений. Представьте себе: машина, алгоритм, принимает решение о чьей-то судьбе. Это же просто уму непостижимо! Ведь в каждом деле есть нюансы, есть человеческий фактор, который никакой самый умный ИИ не сможет учесть.

О таких случаях в последнее время стало известно. И это только вершина айсберга, я уверен. Сколько всего еще скрыто от глаз общественности? Страшно даже подумать.

Теме искусственного интеллекта планируем посвятить большие парламентские слушания в конце года. Это очень важная инициатива, потому что нам нужно не просто обсуждать, а принимать какие-то конкретные решения. Законодательство должно успевать за технологическим прогрессом, иначе мы окажемся в ситуации, когда реальность опередит наши возможности ее регулировать.

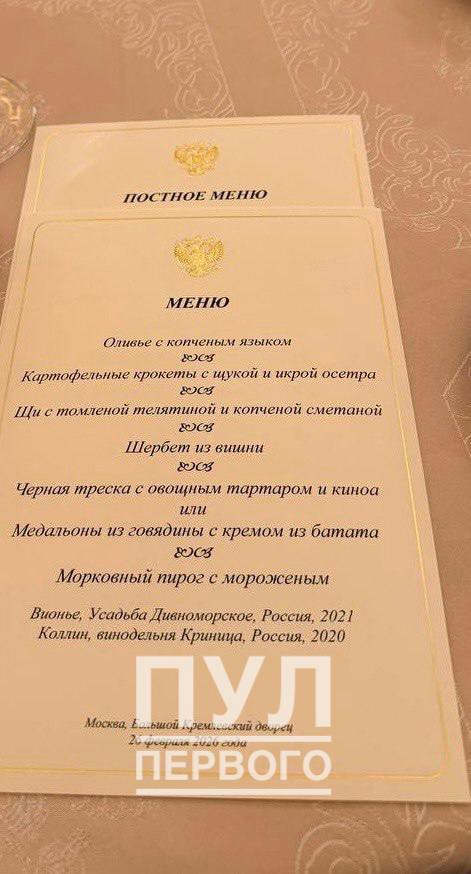

Уже сейчас поступает много обращений об активном применении ИИ при создании различного вида контента — фото, видео, текстов. Мы видим, как легко теперь создаются фейковые новости, дипфейки, которые выглядят настолько реалистично, что отличить их от настоящих практически невозможно. Это открывает невиданные ранее возможности для манипуляций и обмана.

Которые зачастую невозможно отличить от настоящих. Вот в этом и кроется главная опасность. Когда мы теряем способность доверять тому, что видим и читаем, когда любой контент может быть умело подделан, мы теряем основу для формирования собственного мнения и принятия взвешенных решений.

При этом сгенерированный искусственным интеллектом продукт иногда используют в противоправных целях, а также для введения в заблуждение людей. Мошенники, злоумышленники – они всегда ищут новые инструменты, и ИИ для них – это просто кладезь возможностей. От финансовых пирамид, замаскированных под солидные инвестиционные проекты, до создания фальшивых аккаунтов для распространения дезинформации.

Встаёт вопрос о маркировке контента, созданного ИИ. Это, пожалуй, один из самых насущных вопросов на данный момент. Если мы не будем знать, что перед нами – реальность или чья-то цифровая фантазия, то как мы будем жить дальше? Маркировка – это не просто техническая деталь, это гарантия нашей информационной безопасности и права на правду.

Предлагаю его обсудить. Потому что это касается каждого из нас. Это вопрос нашего будущего, нашей способности критически мыслить и отличать правду от вымысла.

Как вы считаете? Какие у вас есть идеи по этому поводу? Может быть, у вас уже есть опыт столкновения с контентом, созданным ИИ, и вы можете поделиться своими наблюдениями?

Жду ваших комментариев. Мне очень интересно узнать ваше мнение, ведь только вместе мы сможем найти верные ответы на эти сложные вопросы.

Подписывайтесь на мой канал в МАХ!